Local AI: GGUF vs EXL2 quantization deep dive

Local AI: GGUF vs EXL2 Quantization Deep Dive – ২০২৬ সালের সেরা ফরম্যাট কোনটি?

২০২৬ সালে এসে Local LLM (Large Language Model) ইকোসিস্টেম এতটাই উন্নত হয়েছে যে, এখন আমরা স্মার্টফোন থেকে শুরু করে হোম সার্ভারে অনায়াসেই বড় বড় মডেল রান করতে পারছি। কিন্তু এই রান করার পেছনে সবচেয়ে বড় জাদুকরী ভূমিকা পালন করে Quantization। আপনি যদি একজন AI এন্থুজিয়াস্ট হন, তবে আপনি অবশ্যই GGUF এবং EXL2 ফরম্যাট দুটির নাম শুনেছেন। কিন্তু এদের মধ্যে মূল পার্থক্য কী? কেন একই মডেল GGUF-এ একরকম আচরণ করে আর EXL2-তে আরেকরকম? আজ আমরা এই “Quantization Wars” এর গভীরে প্রবেশ করব।

Quantization কী এবং কেন এটি প্রয়োজন?

সহজ ভাষায় বলতে গেলে, Quantization হলো একটি বিশাল মডেলের Weights (সাধারণত FP16 বা BF16 ফরম্যাটে থাকে) সংকুচিত করে ছোট করা (যেমন ৪-বিট বা ৬-বিট)। এর মাধ্যমে মডেলটি কম VRAM বা RAM ব্যবহার করে দ্রুত চলতে পারে।

২০২৬ সালের প্রেক্ষাপটে আমরা এখন শুধু GGUF বা GPTQ তেই সীমাবদ্ধ নেই; আমাদের কাছে এখন NVFP4 (NVIDIA FP4) এর মতো অত্যাধুনিক ফরম্যাটও রয়েছে। তবুও, কমিউনিটিতে GGUF এবং EXL2 সবথেকে জনপ্রিয়।

GGUF: The Universal King of Local AI

Versatility and CPU+GPU Offloading

GGUF (GPT-Generated Unified Format) হলো llama.cpp ইকোসিস্টেমের প্রাণ। এর সবথেকে বড় সুবিধা হলো এটি হার্ডওয়্যার agnostic। আপনার যদি দামী GPU না থাকে, আপনি CPU এবং System RAM ব্যবহার করে মডেল চালাতে পারবেন।

- একাধিক প্ল্যাটফর্ম সাপোর্ট: Windows, Linux, macOS (Metal), এমনকি Android-এও এটি চমৎকার কাজ করে।

- Split Memory: আপনার গ্রাফিক্স কার্ডের মেমোরি যদি কম হয়, তবে GGUF মডেলের কিছু অংশ GPU-তে এবং বাকি অংশ RAM-এ অফলোড করে রান করা যায়।

- Stability: GGUF ফরম্যাটে মডেলের কোয়ালিটি লস খুব কম হয়, বিশেষ করে non-English ল্যাঙ্গুয়েজ পারফরম্যান্সে এটি আজও অপ্রতিদ্বন্দ্বী।

GGUF এর সীমাবদ্ধতা

GGUF এর প্রধান সমস্যা হলো স্পিড। এটি EXL2 বা AWQ এর মতো দ্রুত নয়, বিশেষ করে যখন পুরো মডেলটি GPU-তে লোড করা থাকে। প্রম্পট প্রসেসিং এবং টোকেন জেনারেশন স্পিড এখানে কিছুটা ধীরগতির হতে পারে।

EXL2: The Speed Demon for NVIDIA Users

Extreme VRAM Optimization and Bitrate Flexibility

EXL2 (ExLlamaV2) ফরম্যাটটি বিশেষভাবে তৈরি করা হয়েছে NVIDIA GPU ইউজারদের জন্য। এটি GPTQ এর উত্তরসূরী এবং এর পারফরম্যান্স অবিশ্বাস্য।

- Variable Bitrates: GGUF-এ আপনি সাধারণত ৪-বিট বা ৫-বিট ফিক্সড কোয়ান্ট পান। কিন্তু EXL2-তে আপনি ৪.২৫, ৫.০ বা ৮.০ এর মতো কাস্টম বিটরেট ব্যবহার করতে পারেন যাতে আপনার VRAM এর একদম শেষ অংশটুকুও ব্যবহার করা যায়।

- Incredible Speed: টোকেন জেনারেশন স্পিডের দিক থেকে EXL2 প্রায়শই GGUF-কে ২x থেকে ৩x ব্যবধানে হারিয়ে দেয়।

- VRAM Efficiency: এটি সরাসরি GPU মেমোরিতে কাজ করে, যার ফলে ল্যাটেন্সি অনেক কম থাকে।

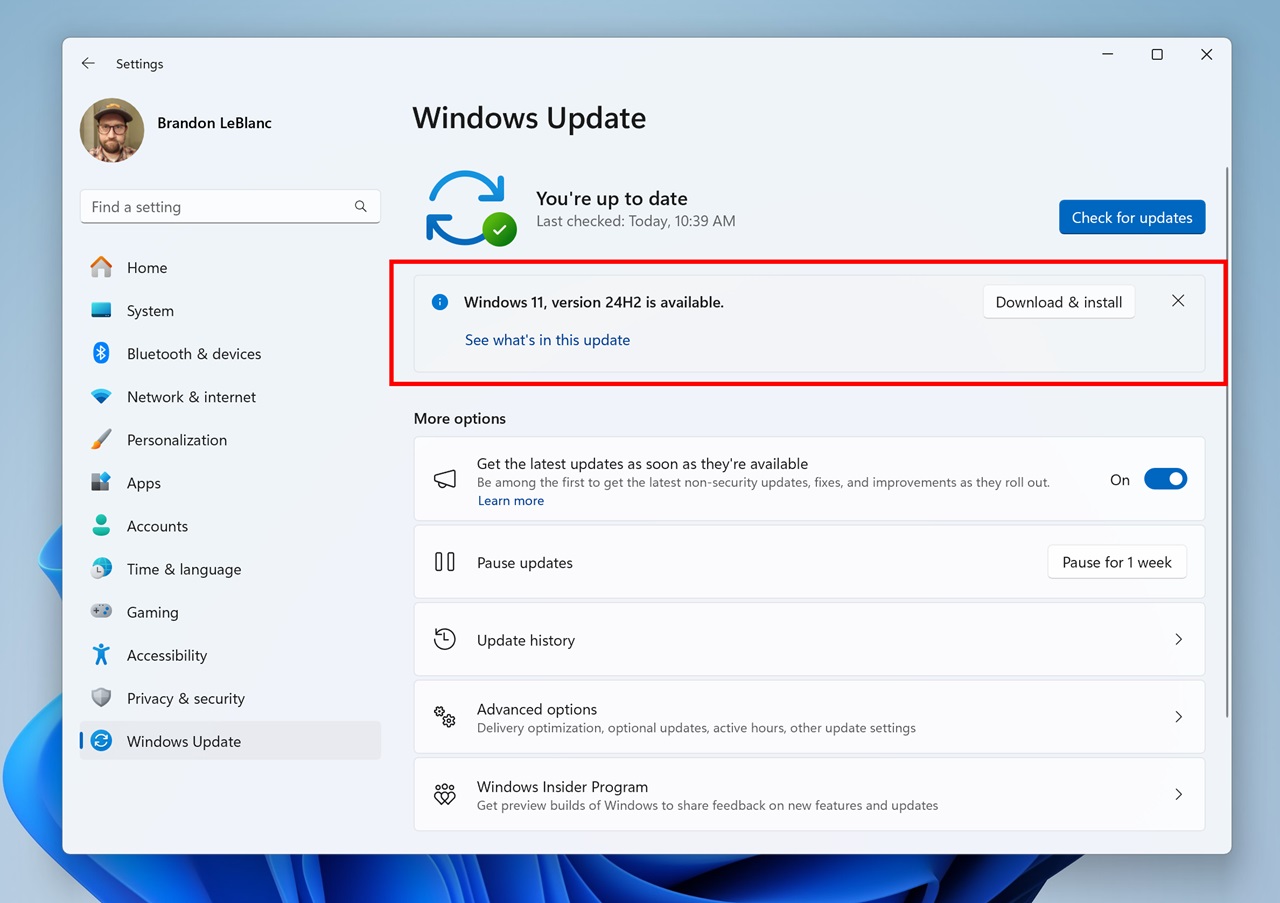

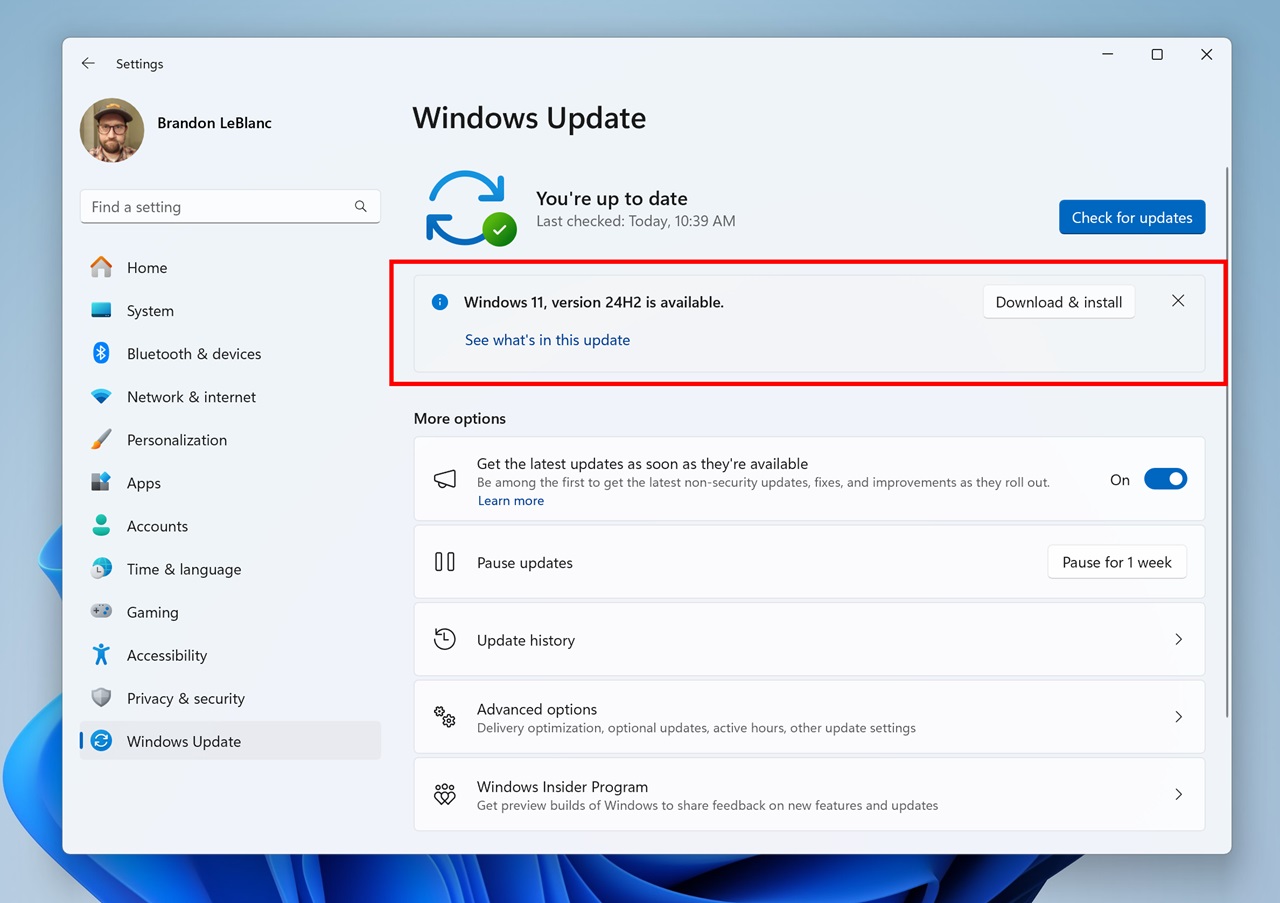

ভিডিও: GGUF এবং EXL2 এর পারফরম্যান্স তুলনা (২০২৬ আপডেট)

GGUF vs EXL2: কেন একই মডেলের উত্তরে পার্থক্য হয়?

অনেকেই লক্ষ্য করেছেন যে, একই মডেলের GGUF ভার্সন খুব সুন্দর উত্তর দিচ্ছে, কিন্তু EXL2 ভার্সনটি কিছুটা অদ্ভুত বা “Generic” উত্তর দিয়ে কথা এড়িয়ে যাচ্ছে। এর বৈজ্ঞানিক কারণ রয়েছে।

Calibration Dataset এর প্রভাব

EXL2 কোয়ান্টাইজেশনের সময় একটি “Calibration Dataset” ব্যবহার করা হয়। যদি এই ডাটাসেটটি মডেলের মূল ট্রেইনিং ডাটার সাথে সামঞ্জস্যপূর্ণ না হয়, তবে মডেলের বুদ্ধিমত্তা বা “Perplexity” ক্ষতিগ্রস্ত হয়। অন্যদিকে GGUF একটি ভিন্ন গাণিতিক পদ্ধতি ব্যবহার করে যা অনেক ক্ষেত্রে মডেলের অরিজিনাল ওজন বাWeights এর কাছাকাছি থাকে।

Non-English Context Performance

বেঞ্চমার্কে দেখা গেছে, বাংলা বা অন্যান্য নন-ইংলিশ ভাষার ক্ষেত্রে GGUF এর কোয়ালিটি অনেক বেশি স্থিতিশীল। EXL2 অনেক সময় বেশি বিটরেটেও বাংলায় ভুল গ্রামার বা উল্টোপাল্টা টোকেন জেনারেট করতে পারে, যদি না সেটিকে প্রপারলি ক্যালিব্রেট করা হয়।

২০২৬ সালের নতুন প্লেয়ার: AWQ, GPTQ এবং NVFP4

NVFP4 (NVIDIA FP4)

২০২৬ সালের নতুন গ্রাফিক্স কার্ডগুলোতে NVFP4 ফরম্যাটটি বিপ্লব ঘটিয়েছে। এটি হার্ডওয়্যার লেভেলে কোয়ান্টাইজেশন সাপোর্ট করে, যার ফলে কোয়ালিটি প্রায় BF16 এর মতো রেখেও ৪-বিটের স্পিড পাওয়া সম্ভব। তবে এটি শুধুমাত্র লেটেস্ট আর্কিটেকচারের জন্য সীমাবদ্ধ।

AWQ (Activation-aware Weight Quantization)

AWQ বর্তমানে ইনফারেন্স সার্ভারের জন্য আদর্শ। এটি মডেলের “Salient weights” বা গুরুত্বপূর্ণ ওজনগুলোকে রক্ষা করে কোয়ান্টাইজ করে, ফলে চ্যাটবট বা এজেন্টদের জন্য এটি অত্যন্ত কার্যকর।

সরাসরি তুলনা: কোনটি আপনার জন্য?

| ফিচার | GGUF | EXL2 | AWQ / GPTQ |

|---|---|---|---|

| হার্ডওয়্যার | CPU, Apple Silicon, GPU | NVIDIA GPU (শুধুমাত্র) | GPU (NVIDIA/AMD) |

| স্পিড | মাঝারি / ধীর | অত্যন্ত দ্রুত | দ্রুত |

| মেমোরি ম্যানেজমেন্ট | RAM + VRAM | শুধুমাত্র VRAM | শুধুমাত্র VRAM |

| ব্যবহারের সহজলভ্যতা | খুব সহজ (LM Studio, Ollama) | উন্নত (Oobabooga, TabbyAPI) | মাঝারি (vLLM, TGI) |

| কোয়ালিটি (Non-English) | সেরা | ভালো (যদি ঠিকমতো করা হয়) | ভালো |

উপসংহার: আমাদের পরামর্শ

আপনি যদি সাধারণ ইউজার হন এবং আপনার কাছে একটি ম্যাকবুক বা সাধারণ পিসি থাকে, তবে GGUF আপনার প্রথম পছন্দ হওয়া উচিত। এটি ঝামেলামুক্ত এবং কোয়ালিটির দিক থেকে নির্ভরযোগ্য।

কিন্তু আপনি যদি একজন মেকার বা ডেভেলপার হন যার কাছে RTX 50 বা 60 সিরিজের কার্ড আছে এবং আপনি রিয়েল-টাইম স্পিড চান, তবে EXL2 এর কোনো বিকল্প নেই। তবে মনে রাখবেন, EXL2 ব্যবহারের সময় মডেলের সঠিক বিটরেট এবং ডাটাসেট যাচাই করে নেওয়া জরুরি।

২০২৬ সালে লোকাল এআই এর ভবিষ্যৎ এখন আমাদের হাতের মুঠোয়। কোয়ান্টাইজেশন আমাদের সুযোগ করে দিচ্ছে বিশাল বিশাল সব প্যারামিটার মডেলকে নিজের ড্রয়িংরুমে বসে চালানোর। আপনি কোনটি ব্যবহার করছেন? কমেন্টে আমাদের জানান।

আরও জানতে পড়ুন (Resources):

- Quantization Methods Compared: GGUF, AWQ, GPTQ, EXL2, NVFP4 – ai.rs

- Why such a drastic difference between EXL2 and GGUF of the same …

- GGUF vs. EXL2: A Deep Dive into Model Quantisation in 2026

- Quantization Strategies (GGUF, EXL2, AWQ) | ShShell.com

- Model Formats Explained: GGUF vs GPTQ vs AWQ vs EXL2